Nobel de Física premia avanços em redes neurológicas artificiais e modelos linguísticos

Reconhecimento facial, tradução automática e detecção de tumores são alguns dos avanços possibilitados pelas redes artificiais de aprendizagem, pelas quais John Hopfield e Geoffrey Hinton receberam o Prêmio Nobel de Física de 2024 nesta terça-feira (8).

Graças ao seu trabalho pioneiro, os computadores não se limitam a seguir uma série de instruções, mas sim a "aprender através de exemplos".

- A memória associativa de Hopfield -

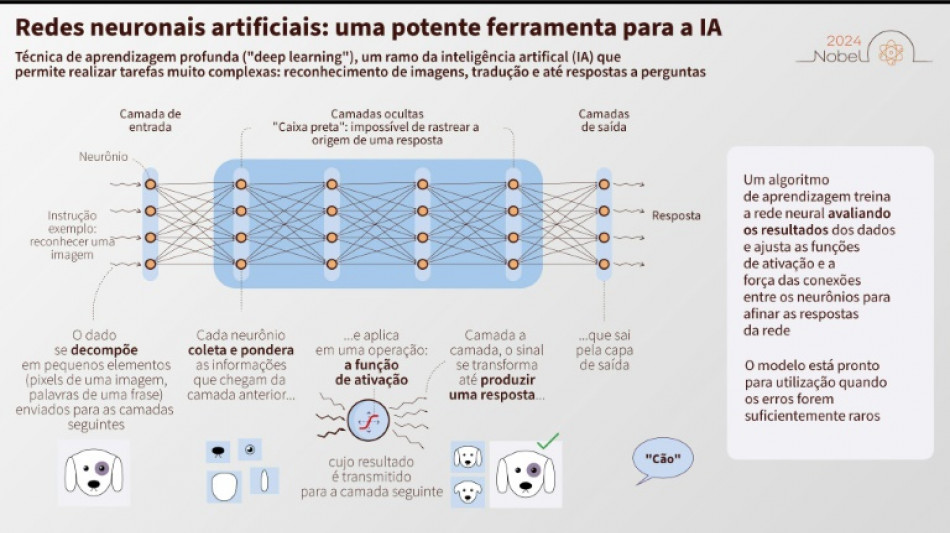

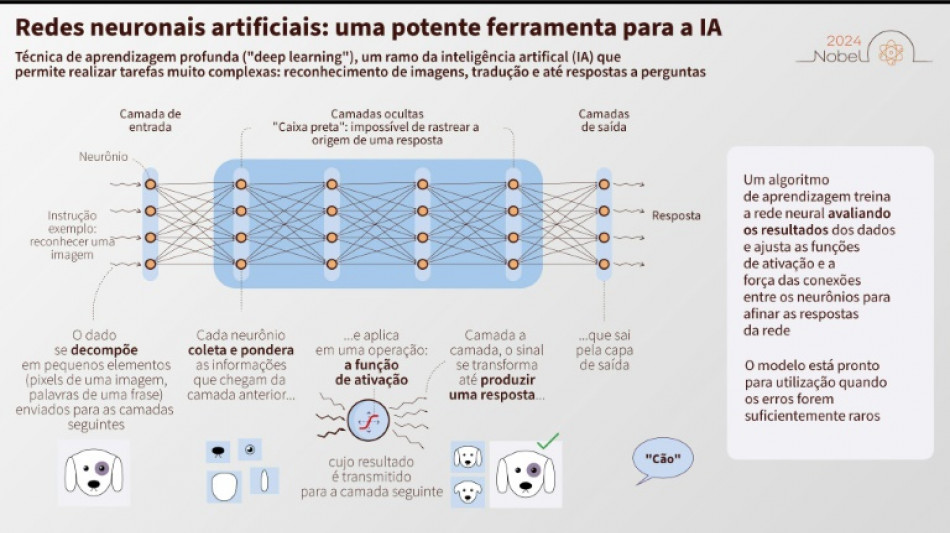

O princípio da "aprendizagem automática" é inspirado no funcionamento do cérebro humano e, mais especificamente, nas redes neuronais.

Nos humanos, o aprendizado reforça as conexões entre determinados grupos de neurônios e enfraquece outras, desenhando uma espécie de mapa de conexões para uma determinada imagem. Em 1982, o físico John Hopfield transferiu esta operação para uma rede artificial que leva o seu nome.

Nesta rede, o sistema funciona "com um comportamento que busca naturalmente o mínimo de energia", explica à AFP Damien Querlioz, pesquisador francês especializado em sistemas de processamento de informação do Centro de Nanociências e Nanotecnologias.

Hopfield comparou o armazenamento de um padrão na memória da rede com o percurso mais eficiente de uma bola rolando por uma paisagem de picos e vales. Quando a rede processa um padrão próximo ao salvo, a bola segue um caminho de gasto de energia semelhante, levando-a ao mesmo ponto.

"Com técnicas da física estatística, ele demonstrou como um algoritmo simples poderia armazenar certos padrões na memória, que poderiam então ser recuperados", explica Francis Bach, diretor do laboratório de aprendizagem estatística SIERRA na Ecole Normale Supérieure em Paris.

- A aprendizagem profunda de Hinton -

Geoffrey Hinton construiu seu trabalho sobre as bases estabelecidas por Hopfield. "Ele mostrou que é possível aprender de forma eficaz com redes neuronais de múltiplas camadas", explica Bach. Em outras palavras: "Quanto mais camadas houver, mais complexo pode ser o comportamento, e quanto mais complexo o comportamento, mais fácil será aprender de forma eficaz".

Desde a década de 1980, Hinton não parou de "propor novos algoritmos de aprendizagem para comportamentos cada vez mais complexos", acrescenta.

No final daquela década, os pesquisadores começaram a trabalhar "no reconhecimento de caracteres, que é mais simples do que imagens naturais", diz Bach.

- Dados e poder de cálculo -

Posteriormente, a disciplina sofreu um certo declínio até a década de 2010. Para que suas descobertas funcionassem, era necessário maior poder de cálculo e, sobretudo, enormes quantidades de dados, ingredientes essenciais para as redes neuronais, explica Querlioz.

As máquinas só podem aprender bem se receberem suficientes "exemplos da inteligência que você deseja que elas reproduzam".

O comitê do Nobel recorda que, em seu artigo publicado em 1982, Hopfield utilizou uma rede muito simples com "menos de 500 parâmetros para monitorar", enquanto os gigantescos modelos de linguagem atuais contêm "um quadrilhão".

- Para que serve? -

A grande onda de aprendizagem profunda da década de 2010 "revolucionou tudo relacionado ao processamento de imagens e ao processamento de linguagem natural", observa Francis Bach.

Querlioz cita exemplos como "assistentes de voz, reconhecimento facial" ou programas de criação de imagens como o DALL-E.

Mas estes avanços vão muito além daquilo que o público em geral percebe. "O que permite que o software do telefone diferencie os rostos de seus filhos também permite reconhecer um tumor", diz Bach.

Também facilita a análise e classificação de enormes quantidades de dados recolhidos em institutos de pesquisa de física elementar ou o processamento de imagens e espectros capturados na observação de estrelas.

L.Panchal--BD